¿Cómo la difracción afecta a la nitidez de las imágenes y cómo esto limita la resolución posible máxima de los sensores?

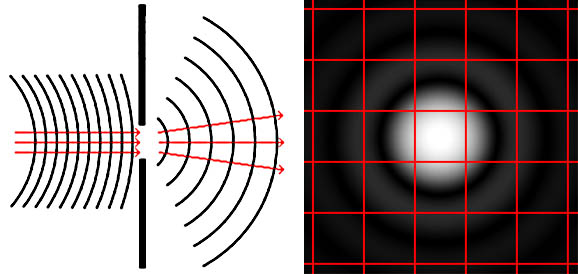

En lo que se refiere a imagen fotográfica, la difracción provoca que un haz de luz, al atravesar un orificio pequeño como el diafragma, se disperse llegando al sensor (o película) no ya como como tal rayo de luz sino que se extiende dando lugar a una mancha que se llama disco de Airy. A medida que cerramos más el diafragma, la luz se dispersa más y el disco de Airy crece emborronando la imagen. Cuando llega a tener un tamaño físico mayor que el de un píxel, simplemente ya no podremos resolver tanto detalle.

En la página de Cambridge in Colour, existe una sencilla calculadora para saber cuándo la difracción del diafragma está afectando a la nitidez. Introduciendo en ella la resolución y el tamaño –formato- del sensor , la apertura del diafragma, y fijando como límite del círculo de confusión dos píxels, podemos ver cuándo la difracción está afectando a la nitidez de nuestra imagen, y ya no se puede resolver más detalle. A partir de un valor de apertura, cerrar más el diafragma hará que perdamos detalle. Como resumen, el límite que impone este fenómeno para las cámaras DSLR más típicas podría ser el siguiente:

- Para las cámaras de formato Cuatro Tercios: f:8 para 12mpix

- Para las cámaras APS-C con factor de recorte 1,5-1,6: f:11 para 12 mpix, y de f:8 para 15 mpix

- Para las cámara con sensor FF: f:16 para 12 mpix y de f:11 para 24mpix

La evolución de la tecnología de los sensores hará sin ninguna duda que ganemos rango dinámico e imágenes limpias de ruido para valores de ISO mayores, pero el límite que fija la difracción para que no se pueda aumentar la resolución de los sensores simplemente no se puede superar, va contra las leyes de la física.

Fuente: www.caborian.com